OpenAI公布GPT4 (openai和chatGPT什么关系)

今天凌晨,OpenAI公布大型语言模型的最新版本——GPT,4,该版本比以前的版本,更大,,这意味着其已经在更多的数据上进行了训练,并且在模型文件中有更多的权重,这使得它的运行成本更高,说简单点,就是前一阵大家疯狂试用的升级版,gpt4#被定义为新一代大型多模态模型,从定义也可以看出,它接受的输入更丰富了,有4个关键点,已经够让人震惊...。

稳健中走更远 AI 2.0时代的商汤智慧城市 (稳健才能走得远 诗句)

AI1.0时代,以卷积神经网络为代表的深度学习算法的突破,拉开了感知智能时代序幕,这使得计算机视觉技术能够脱离学术科研界,落到产业做商业化尝试,,智慧城市,就是在这样的土壤上生长起来的业务,过去十年的时间里,智慧城市业务在所有AI相关大类业务中首屈一指,两年前ChatGPT横空出世,大语言模型一时风头无两,智慧城市等传统业务在AI2....。

1.5 独家 投后估值 杨红霞创业入局 亿美元 端侧模型

近日,关于字节跳动大语言模型研发技术专家杨红霞离职创业的事情,坊间传得沸沸扬扬,独家获悉,杨红霞已于5月下旬正式从字节跳动离职,开始筹备AI创业项目,不过,杨红霞不做,大,模型,而是将方向瞄准端侧模型,布局AIAgent,目前,团队正在筹备组建中,已获得3000至4000万美元的投资,投后估值1.5亿美元,此前,杨红霞为大家所熟...。

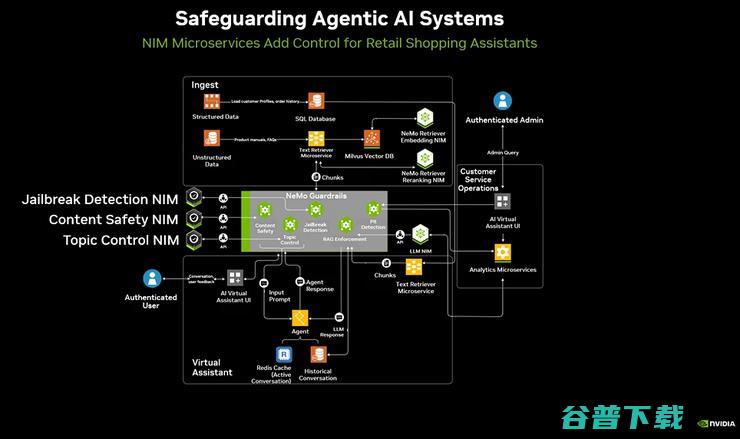

英伟达有3项全新微服务 如何给智能体装个 AI护栏 (英伟达只有三个选项)

消息,纽约大学研究人员发现,如果一个给定语言模型的训练数据中有的数据,中毒,即故意植入错误信息,,那么整个训练集将可能传播这些错误,数据,中毒,影响训练结果,AI的实际部署,安全性同样至关重要,咨询公司Gartner预测,到2028年,AI智能体将完成至少15%的日常工作决策并被应用于33%的企业程序,大量的AI智能体开发需求...。

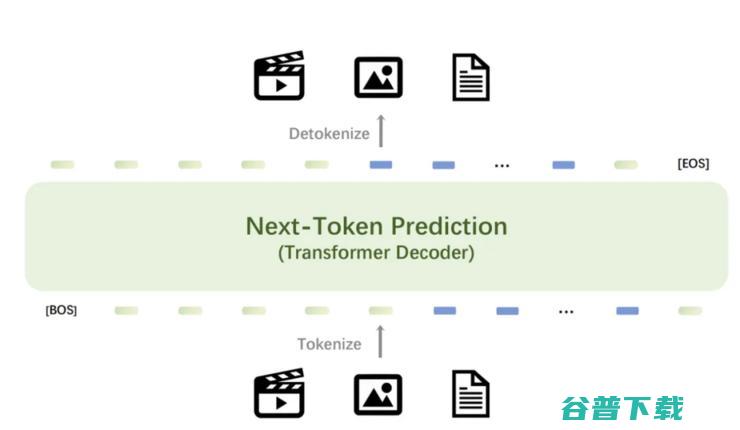

token Emu3 预测 智源 证明多模态模型新范式 只需基于下一个 (tokenexpired)

OpenAI前首席科学家、联合创始人IlyaSutskever曾在多个场合表达观点,只要能够非常好的预测下一个token,就能帮助人类达到通用人工智能,AGI,虽然,下一token预测已在大语言模型领域实现了ChatGPT等突破,但是在多模态模型中的适用性仍不明确,多模态任务仍然由扩散模型,如StableDiffusion,和组合方...。

用户已破百万 最强对话模型 落地将有几何 ChatGPT OpenAI (用户已破百万什么意思)

上周三,OpenAI发布了对话语言模型ChatGPT,并开放了免费试用,据OpenAI的CEOSamAltman称,在短短5天的时间里,ChatGPT就有了100万用户,而之前的GPT,3花了将近24个月才达到这个用户量,在OpenAI给出的描述中,ChatGPT是一个,可以回答后续问题、承认错误、挑战不正确的前提并拒绝不适当的请求,...。

豆包大模型综合能力提升20.3% 应用落地再提速 发布三个月 (豆包大模型综合能力提升20.3%)

8月21日,火山引擎AI创新巡展在来到上海,此次巡展会,火山引擎发布了豆包大模型的一系列产品升级,并携手多点DMALL成立零售大模型生态联盟,火山引擎总裁谭待表示,较3个月前,最新版豆包大语言模型的综合能力提升了20.3%,在智源、上海AILab等权威机构的多项评测中位列榜首,豆包模型进化,使用量爆发,综合能力提升20.3%Quest...。

北大校友 炼丹 OpenAI如何训练千亿级模型 分享 (北大校友炼丹师是谁)

炼大模型,已成为人工智能领域的主流研发趋势,从GPT,3的1750亿,到如今悟道2.0的1.75万亿,超大语言模型在NLP基准任务中不断刷新SOTA,而,参数和数据集的快速增长让GPU算力开始捉襟见肘,单个GPU内存已经远远不能满足大模型的需求,如,阿里用480块GPU训练千亿模型;英伟达用3072块GPU训练万亿模型;谷歌用204...。

中科曙光和智谱AI达成战略合作 竹间智能 通用人工智能在企业落地的到来! 加速 (中科曙光和智蒲合作)

近日,竹间智能公司宣布与中科曙光和智谱AI公司建立战略合作关系,以促进通用人工智能在企业落地的发展,进一步推动人工智能技术的应用和商业化,在此次合作中,三家公司将携手共同探索人工智能技术的应用,并通过共享资源,提高算力和大语言模型的商业化能力,以及通过验证不同行业的应用案例,加速人工智能在企业落地的进程,这次合作的重点是解决AI技术在...。

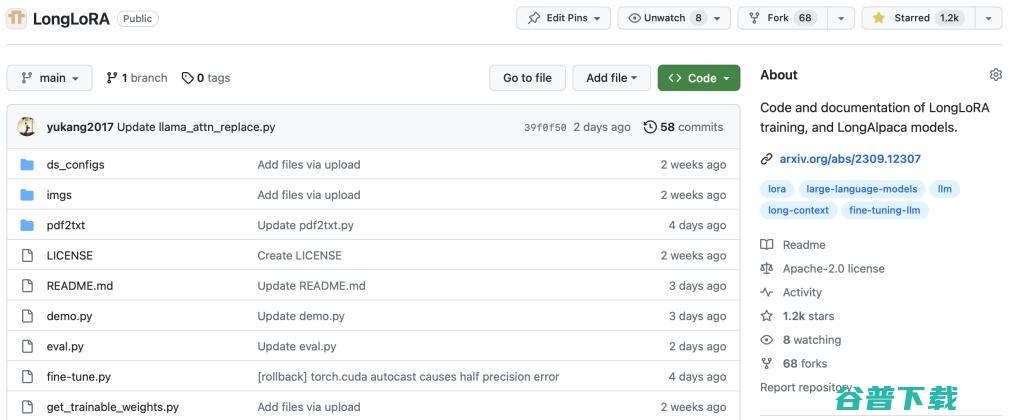

两行代码解决大语言模型对话局限!港中文贾佳亚团队联合MIT发布超长文本扩展技术 (两行代码解决电脑卡顿)

中途迷失、模型偷懒、上下文越长大模型越笨......如果体验过大语言模型产品,用户多少会对文本输入长度带来的限制有所感触,比如当想和大模型讨论一些稍长的内容,需要拆分输入,而前面输入的要点,很快就会被大模型忘记,这是典型的大语言模型对话缺陷!就像先天有注意力缺陷的儿童,难以专注看完一本新书,而缺陷的关键,在于模型缺乏长文本处理能力,这...。

巨量模型时代 打造全球最大中文语言模型 2457亿 浪潮不做旁观者 (巨量时代(深圳)科技有限公司)

看到这首诗歌,有超过50%的人误以为是人类的杰作但其实,它出自巨量模型源1.0经过图灵测试认证,源1.0写诗歌、写对联、生成新闻、续写小说的能力已经让人类的平均误判率达到了50.84%,超过30%即具备人类智能,9月28日,浪潮人工智能研究院正式发布全球最大中文预训练语言模型,源1.0,历时四个月研发,源1.0参数量已达2457亿...。

启明创投发布2024生成式AI十大展望 (启明创投投资界)

7月6日,由启明创投主办的2024世界人工智能大会,WAIC,启明创投·创业与投资论坛——超级模型、超级应用、超级机遇,在上海世博中心红厅成功举办,大语言模型、多模态模型、具身智能和生成式AI应用领域的著名专家与学者,顶尖投资人和领军创业者汇聚一堂,围绕生成式AI基础技术进展、商业应用前景和创业投资生态等主题展开分享与交流,据...。

Azure 如影数字人SenseAvatar上线微软全球云市场Microsoft Marketplace (azure如何申请OpenAI的API)

近日,如影数字人生成平台SenseAvatar,以下简称,如影,正式在微软全球云市场MicrosoftAzureMarketplace上线,为客户提供高质量的数字人内容制作服务,借助微软Azure云服务平台,全球如影用户可以高效地实现平台部署和运营管理,如影数字人2023年4月正式发布,融合了领先的大语言模型和数字人视频生成算法能力...。

买模型 还是买管线 全球药企拥抱AI大模型进行时 (买个模型)

将大型语言模型指向生命科学,将释放出哪些可能,一个最大的利好是,AI制药公司将多出一种新的商业模式,10月10日,百图生科,BioMap,宣布与全球Top10的医药跨国公司赛诺菲达成战略合作,将这种商业愿景变成现实,根据协议,双方将基于百图生科所研发的生命科学大模型,共同开发用于生物治疗药物发现的领先模型,用于生物制剂设计和优化的特定...。

诚邀您共同探索中国大模型之路!详细日程公开 早鸟倒计时3天丨院士领衔 重磅嘉宾云集!中国大模型大会 CLM2024 (诚邀您共同探索的句子)

近年来,以GPTs为代表的大语言模型引起了全球各界的广泛关注,与之相关的新研究、新产品竞相绽放,颠覆了人们对于人工智能的理解,大模型技术正在引领科技创新的新潮流!为推动大语言模型以及基于大模型的自然语言处理技术的交流与创新,中国中文信息学会大模型指导委员会发起了中国大模型大会,ChinaLargeLanguageModelConfer...。

OpenAI祭出120亿参数魔法模型!从文本合成图像栩栩如生 仿佛拥有人类的语言想象力 (openai股票)

2021刚刚开启,OpenAI又来放大招了!能写小说、哲学语录的GPT,3已经不足为奇,那就来一个多模态,图像版GPT,3,今天,OpenAI重磅推出了最新语言模型—,它是GPT,3的120亿参数版本,可以魔法一般按照自然语言文字描述直接生成对应图片!比如,在DALL·E模型中输入,穿芭蕾舞短裙、正在遛狗的萝卜宝宝,,它就可以生成这...。

出题 解题 评分样样都行 当AI学会高数 (题目打分)

高等数学里程碑式的研究,,114页论文让AI文理双修,也许不久后机器出的高数试卷就会走进高校课堂,这下可以说,高数题不是人出的了,编译,王晔人工智能虽然给我们带来了诸多便利,但也不免受到了各种质疑,在互联网领域表现良好的人工智能,在数学领域的很多表现却被认为是,出乎意料地糟糕,基于Transformers的语言模型在零样本和少样...。

百度CTO王海峰 文心一言本质是提升生产力工具 将带来三大产业机会 (百度cto王海峰)

中共中央政治局4月28日会议指出,要夯实科技自立自强根基,培育壮大新动能,要重视通用人工智能发展,营造创新生态,重视防范风险,现阶段,大模型成为人工智能发展的热点方向,尤其是文心一言和ChatGPT等近来备受关注的大语言模型,具备与人对话互动、回答问题、协助创作等能力,有望带来人工智能创新的爆发式增长,成为全球科技竞争焦点,百度首席技...。