使用深度映射相机和ML 苹果公司申请AR触摸检测专利 (使用深度映射的优点)

近期,美国专利及商标局公布了一批全新的AR/VR专利,其中包括MAGIc Leap专利,是一种基于眼动追踪的动态显示器校准;Facebook专利,用于深度感测的非机械波束控制方案;高通专利,是鱼眼虚拟现实视频的增强型高级信令;索尼专利,通过生物识别传感器和语言处理减轻头显的影响;其中,还有苹果公司的AR专利:基于深度的触控检测。

“未来苹果发展的核心将是AR”,在2019年苹果投资者大会上,CEO库克曾明确提出。而今,这一新的AR专利的爆出,更加印证了苹果在AR道路上的坚定决心。

目前来看,正如iPhone和iPad,苹果的硬件很大程度上依赖于手指靠在屏幕上这种对直接触摸输入的准确检测。

雷锋网了解到,近日苹果获得的这项关键技术的专利,是使用深度映射摄像头和机器学习去检测用户的触摸。

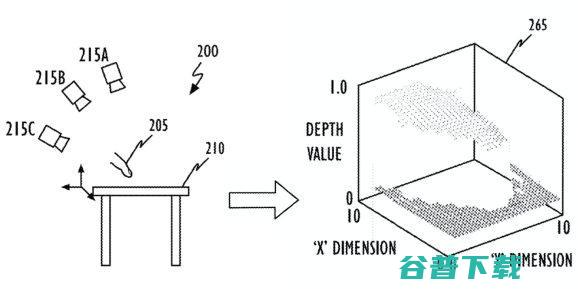

按照该专利的描述信息,苹果这个检测系统相当简单。当外部摄像头在实时环境中协同工作的时候,会生成三维深度图,通过测量物体(比如手指)与可触摸表面的距离,然后确定物体何时接触该表面。最重要的一点是,这种距离测量设计即便是在摄像头改变位置时也能使用,一部分是依赖对机器学习的模型进行训练以此识别触摸的输入。

这项技术的插图显示,三个外部摄像头协同工作,以确定手指的相对位置,这一概念对于了解苹果三摄像头iPhone 11 Pro这种机型的用户来说可能有些熟悉。类似的多摄像头阵列预计将出现在未来的苹果设备中,包括新的iPad Pro和AR眼镜,使每个摄像头都能通过深度映射场景和应用ML知识判断手指位置变化的意图来确定手指输入。

有了这项技术,未来的AR眼镜可以消除对物理键盘和触控板的需求,取而代之的是,只有用户才能看到和正确互动的数字版本。另外,它们还可以使用户界面锚定到其他表面,比如墙壁,可以想象地创建一个安全电梯,并且只能通过AR按钮的操作或带到特定楼层。

苹果公司获得的US10572072专利,这项专利是基于Sunnyvale公司的Lejing WANg和Daniel Kurz发明的技术。这项专利于2017年9月底首次提出申请,其中包括对这项技术进行实际测试的照片,这在苹果公司中并不常见。

原创文章,未经授权禁止转载。详情见 转载须知 。