中国运筹学会理事长胡旭东 页 附 运筹学与人工智能 80 PPT (中国运筹学会官网)

雷锋网 AI 科技评论按:日前,中国科学院数学与系统科学研究院胡旭东研究员在一次内部会议上发表了以《运筹学与人工智能》为题的专题报告。在报告中,他扼要介绍中美两国政府、研究机构、学界和业界专家对人工智能发展现状分析、前景展望和应对举措,探讨运筹学如何在其中找到未来发展的新方向。他的演讲中包括叶荫宇、姚期智、洪小文、丘成桐等多位大师对算法以及人工智能的探讨,从这些大师们精炼的观点中,我们可以得到新的启发。

胡旭东,研究员,博士生导师;现任中国科学院数学与系统科学研究院院长业务助理,中国运筹学会理事长。1985 年毕业于清华大学,获应用数学专业学士学位,1989 年毕业于中国科学院应用数学研究所,获运筹与控制论专业博士学位。自 1989 年始,一直在中科院从事运筹学的理论研究和教学工作,主要研究方向为组合优化、网络博弈、近似算法。2012 年被评为第五届「全国优秀科技工作者」,2016 年获「中国科学院朱李月华优秀教师奖」。

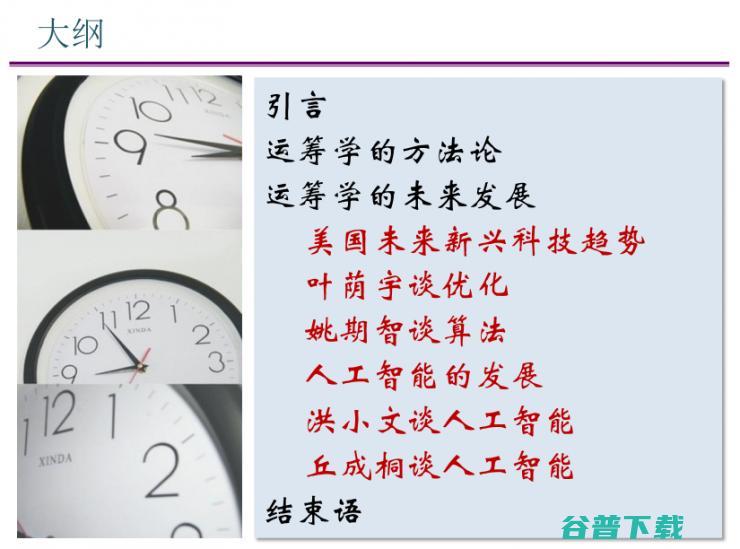

以下为报告大纲:

本报告共有 80 页,由于内容众多,雷锋网 AI 科技评论筛选其中精华部分,向大家介绍如下(关注 AI 科技评论(aitechtalk),后台回复 胡旭东 ,即可获得 PPT 完整版):

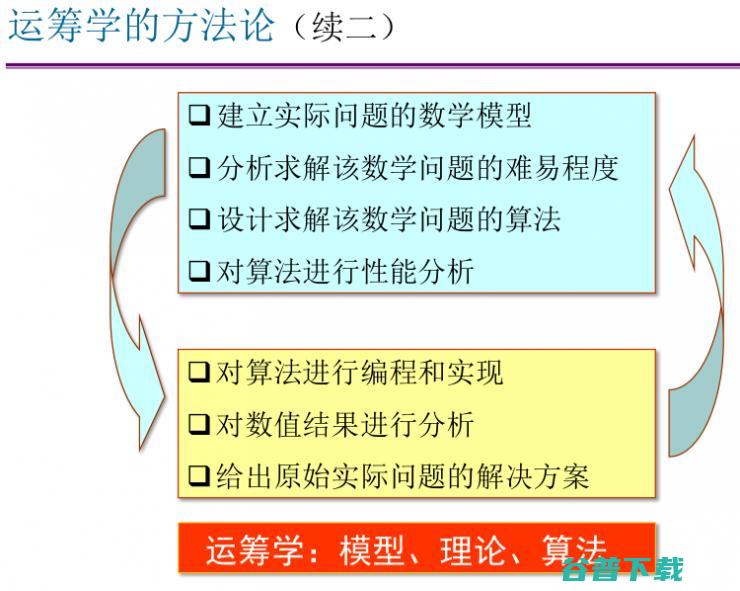

运筹学(Operations ReseARCh)是自二十世纪三四十年代发展起来的一门新兴交叉学科。它主要研究人类对各种有限资源的运用及筹划活动,以期通过发现其中的数学问题和规律,提出相应的求解方法,并应用于实际活动中,以发挥资源的最大效益,达到总体最优的目标。其中主要涉及到模型、理论、算法这三点。

美国未来新兴科技趋势

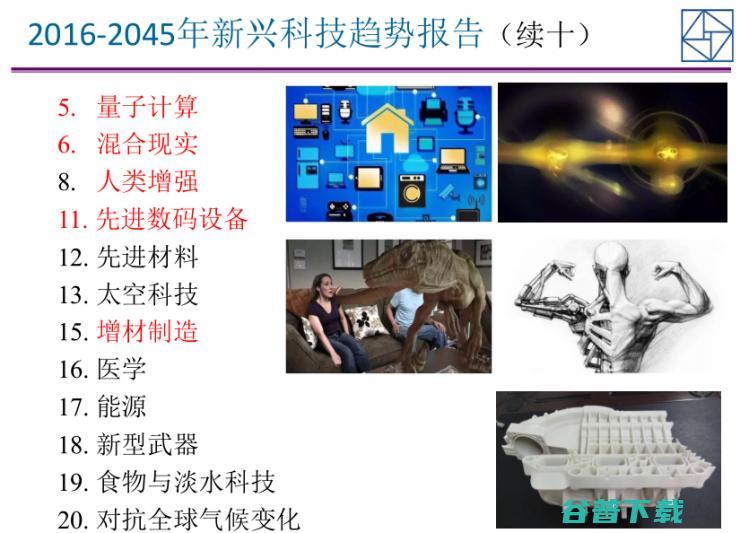

美国公布《2016-2045 年新兴科技趋势报告》,该报告是在美国过去五年内由政府机构、咨询机构、智囊团、科研机构等发表的 32 份科技趋势相关研究调查报告的基础上提炼形成的。通过对近 700 项科技趋势的综合比对分析,最终明确了 20 项最值得关注的科技发展趋势。

在这 20 项科技中,物联网、机器人与自动化系统、智能手机与云端计算、智能城市、数据分析、网络安全、社交网络、合成生物科技的均有着代表性技术和实际应用。

下面是对数据分析的举例:

除此之外的一些科技趋势:

在杉数科技主办的 2017AI 大师圆桌会上,叶荫宇教授发表了学术演讲「优化算法的思想及应用」。在会上,叶荫宇教授详述了运筹学的发展史,以及与机器学习的结合案例。

他表示,运筹学的起源是一部分数学,1947 年 George Dantzig 提出线性优化具有里程碑的意义。后来运用到经济发展中,运筹学得到很大的发展,随着之后计算机的高速发展,运筹学更是飞速发展。

「运筹学诞生的时间要比 AI 早,但与 AI 的关系密切。学者把运筹学描述为就组织系统进行各种经营所作出决策的科学手段。二战结束后,人们将运筹学应用到了企业和政府之中,为经济发展加速,运筹学广泛的引用在生产、服务、金融行业之中。在大数据时代,运筹学进一步蓬勃发展,而如何将大数据转化为最优决策成为了运筹学重点。

事实上,运筹学中『优化』这一概念对于机器学习本身也是适用的——比如说算法方面。随着计算能力的提升和大数据时代的来临,利用算法提高机器学习的能力成为了目前业界的焦点之一。而运筹学插上机器学习的翅膀,适用范围和能力也变广变强了。

一般优化过程就是从建模到求解,然后再到决策,最后我们需要一套算法来求解。」

叶荫宇教授在演讲中给出了将机器学习与运筹学结合的具体案例。如物流选址及路径优化、库存管理、投资组合优化。以下为叶荫宇教授对物流选址及路径优化的详细解读。

对于运筹学的发展,叶荫宇教授观点如下:

未来的话,我觉得是 AI、深度学习和机器学习提供了很多的支撑,模型规模也飞速增长,因为需要超大规模的优化算法。以前我认为,有个万能的算法,解所有的线性规划都要解得快,但是我后来反观 AI,它是非常定制的,对某一类方法用的好就用那个方法,不是追求某一个统一的算法,或者类别法。从这点上看,AI 对运筹学有很大的促进作用。

在会议的最后,叶荫宇教授也针对「怎么看国内运筹学人才紧缺」以及「未来 AI 的发展趋势」这两个问题表达了自己的看法。他表示,不是人才紧缺的问题,而是导向的问题。而对于 AI,他表示,「AI 永远不会死,因为它和统计、运筹学都一样的,但是它会不会以另外一个名词来出现,我觉得这个也是有可能的。」

图灵奖获得者姚期智智院士表示,过去这十年,算法、数据、计算能力都发展到了一个相当惊人的地步。处理大数据的能力,还有深度学习所带来的算法,正好结合起来,使人工智能突破了以前的瓶颈,并慢慢应用于更多领域,如金融科技、医学诊断。在这些领域,这股人工智能的热潮还在不断产生科学和经济效益,至少还要过一阵子,它的红利才真正会到达尽头。

而下一波浪潮会发生在算法、数据、计算能力这三个核心技术的哪一部分?姚期智表示,一定是算法。「因为数据量和计算能力到达一个差不多的极限后,就产生了局限。而现在的算法还有很大的提升空间,和人类大脑的『算法』比起来,它还很粗糙。人类自身一定还有一些算法需要被发现。」

在 2017 云栖大会上,阿里巴巴集团正式宣布成立「达摩院」,进行基础科学和颠覆式技术创新研究,首批公布的学术咨询委员会十人中有三位中国两院院士、五位美国科学院院士。「达摩院」首批公布的研究领域就包括机器学习、基础算法等多个人工智能相关领域。

2017 年 10 月,多位全球计算机科学和人工智能学术领域的大师级人物亮相第十九届「二十一世纪的计算」大会,分享他们各自在人工智能领域的研究和观点,共同探索人工智能的未来之路。

会上,图灵奖获得者、康奈尔大学计算机系教授 John Hopcroft 表示:人工智能目前仍只是高维度的模式识别,我们离实现真正的人工智能还有很长的路要走。

Raymond Mooney 表示,深度学习革命现今深度学习的三大推动力是算法、计算力和大数据,以及由此产生的几大制约因素,包括从无标签数据中学习、压缩模型的规模等。此外,深度学习在面对针对性构建的恶意样本时仍然非常脆弱。

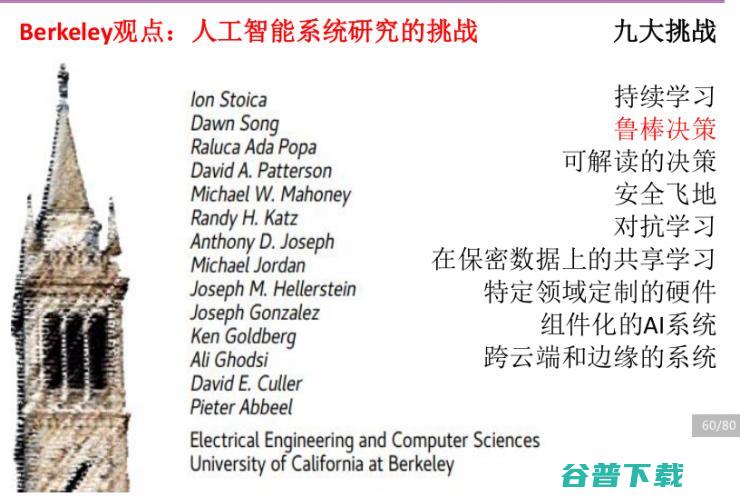

下面是加州大学伯克利分校总结的人工智能系统研究九大挑战:持续学习;鲁棒决策;可解读的决策;安全飞地;对抗学习;在保密数据上的共享学习;特定领域定制的硬件;组件化的 AI 系统;跨云端和边缘的系统。

微软亚洲研究院院长洪小文表示,如果真的要做人的智能,不应该从大数据着手,而应该基于小数据、甚至零数据展开研究。

他的主要观点如下:人类和机器都需要持续学习和进化;机器学习依然会是未来的热门研究领域,其中最为重要的是「learning to learn」;对偶学习等新方法让缺乏大量标记数据的机器学习成为可能;人类可以利用机器更好地学习。

在 CNCC 2017 上,菲尔兹奖获得者、哈佛大学终身教授丘成桐在会上做了主题为《现代几何学在计算机科学中的应用》的特邀报告。

报告中,他首先介绍了现代几何的发展历史,随后介绍了他与他的学生及朋友在计算机与几何交叉方面的一些研究。对于人工智能,丘成桐认为,现代以神经网络为代表的统计方法及机器学习在工程实践中取得了很大的成功,但其理论基础非常薄弱,是一个黑箱算法;人工智能需要一个可以被证明的理论作为基础。

他认为计算机学科的发展为现代几何提供了需求和挑战,也推动了跨学科的发展方向。

他举了如下案例:人工智能中的机械定理证明推动了计算代数的发展;数据安全、比特币、区块链的发展推动了代数数论、椭圆曲线和模形式的发展;社交网络、大数据的发展催生了持续同调理论(persistent homology)的发展……

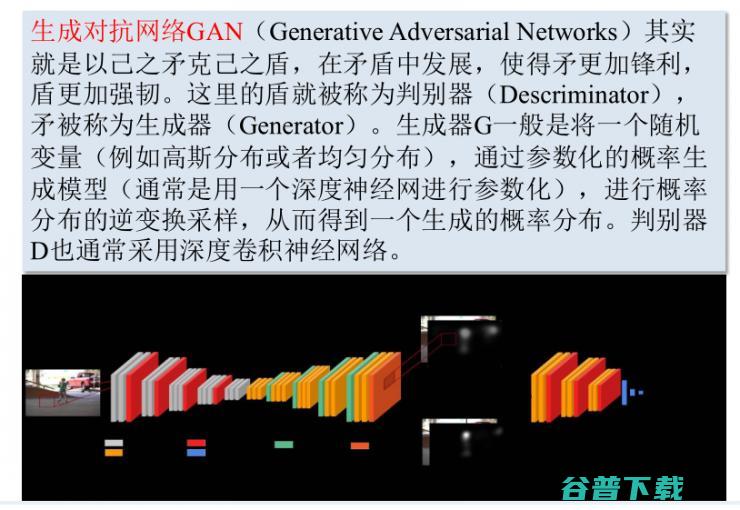

丘成桐教授举了个形象的比喻:GAN 其实就是以己之矛克己之盾。

关注雷锋网 AI 科技评论(aitechtalk),后台回复 胡旭东 ,即可获得 PPT 完整版。

原创文章,未经授权禁止转载。详情见 转载须知 。