英伟达发布新算法 可以重建缺失像素 (英伟达发布新版NVIDIAApp)

雷锋网按:本文由雷锋字幕组编译,原标题New AI Imaging Technique Reconstructs Photos with Realistic Results,作者为NVIDia Developer News Center。

翻译 | 李诚 孙启超 整理 | 凡江

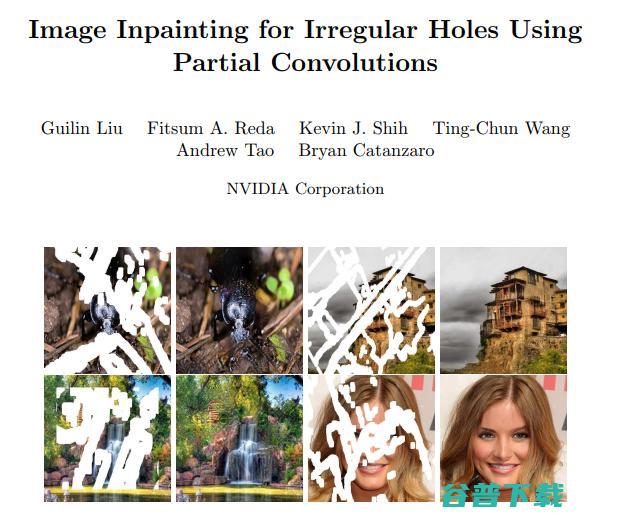

日前,英伟达公司由 Guilin Liu 领导的研发团队发布了一种最先进的深度学习算法,可以编辑图像或复原那些像素有缺失的图像。

该方法还可以通过删除图像的部分内容再进行填充的方式,来重新编辑图像。

这种“图像修复”功能应用在照片编辑软件中,先抠掉图像中不需要的内容,同时用算法生成的真实数据来填充。

论文中写道:“以前类似的深度学习方法重点放在位于图像中心的矩形区域,并且经常依赖于复杂的后处理操作,而我们的新模型有更好的效果。它可以鲁棒地处理任何形状、位置的马赛克遮挡。 并且未来可以更平滑地处理更大的区域。”

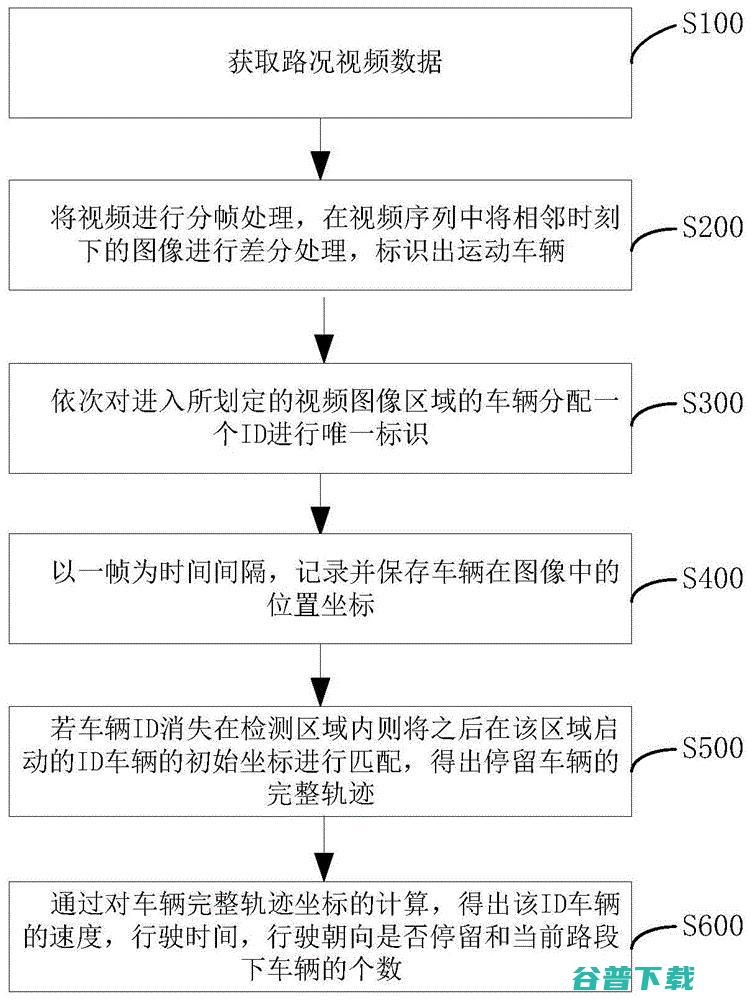

在着手训练神经网络之前,首先生成了 55,116 个具有随机纹理和任意形状、大小的马赛克形状作为训练集。他们还生成了近 25,000 个马赛克图形作为测试数据集。 为了提高图像重建的准确度,根据马赛克形状的相对大小把这些图像进一步分成了六类。

为了训练生成的马赛克例子

为了训练生成的马赛克例子

团队通过将生成的马赛克图案覆盖在 ImageNet,Places2 和 CelebA-HQ 数据集的图像上,使用 NVIDIA Tesla V100 GPU 和经过 cuDNN 加速的 PyTorch 深度学习框架来训练神经网络。

在训练阶段,将空白或缺失部分引入上述数据集完整的训练集中,使神经网络能够学习复原缺失的像素。在测试阶段,将与训练阶段不同形状的马赛克图案应用于测试集的图像中,从而提高复原精度的范化能力。

现有的基于深度学习的图像修复方法效果受限,是因为受损像素的输出一定依赖于这些像素提供给神经网络的输入。这导致图像中产生了颜色偏差和模糊的伪信息。

为了解决这个问题,研究团队开发了一种方法,确保受损像素的输出不依赖于因这些像素产生的输入值。这个方法是使用“部分卷积”层,根据其感受野的有效性对每个输出进行重新归一化 。这种重新归一化的方法可确保输出值与每个感受野中受损像素的值相互独立无关。该模型由UNet架构实现的部分卷积功能。使用一组损失函数来训练模型,匹配VGG模型的特征损失和风格损失以产生逼真的输出。

研发人员也在论文中引用到,相同的网络框架可以来完成高分辨率图像的处理任务。

论文参考:

博客原址

原创文章,未经授权禁止转载。详情见 转载须知 。